數位部擬於12月提出公務機關AI應用指引,要教機關評估AI工具、專案管理及做好風險控管

圖片來源: 數位部 數位部正規畫2026年到2030年政府轉型發展目標,然而在2026年之前,數位部將先祭出配套措施,引導政府機關嚐試導入AI,其中之一是目前正在研擬中,預計今年12月將釋出的政府機關AI應用指引,數位部數位政府司長王誠明將其比喻為電玩攻略,數位部自己則將扮演教練,輔導玩家(機關)依照應用指引以達成轉型目標。 王誠明表示,大型政府機關因擁有的資源較多,很早便投入發展AI應用,例如數據分析型AI或辨識型AI,相較於這些優等生,有的機關可能因為資源有限,或曾經測試AI應用,但發現相關的資料整備不足,服務訓練等配套做法也需調整,最終可能回到既有的做法,數位部希望拉齊各機關的水平,除了規畫中的2026年到2030年大型發展計畫,數位部也提出相關配套措施,如AI人才培訓,以及供機關導入AI之前的試驗環境,評估適合機關自己的LLM模型,還有供政府機關參考的AI應用指引。 相較於行政院及所屬機關(構)使用生成式AI參考指引,從規範面要求公務人員使用生成式AI不得使用機敏資料,不得以生成式AI產生內容直接取代承辦人員客觀及專業判斷,需經過人工審核等等,透過規範面避免公關機關錯誤運用AI。 王誠明認為這些屬於管制面的規範,缺少教導機關如何發展AI應用,「如同沒有教你怎麼開車,因此透過AI應用指引教導你如何開車」,他說。 歐盟將AI應用風險分為4級 然而在導入AI之前,應該先建立AI風險管理,避免AI帶來負面影響。依照國科會提出我國的人工智慧基本法第十條規定,應由數位部參國際標準或規範,提出與國際介接的人工智慧風險分級框架,王誠明指出,數位部尚未提出我國風險分級框架,數位部未來會參考國際規範,例如歐盟的AI Act法案風險管理框架、美國NIST提出的風險管理框架AI RMF等。 以歐盟為例,AI Act將AI風險畫分為4級,不可接受的風險(Unacceptable Risk)、高風險(High Risk)、有限風險(Limited Risk)、最低風險(Minimal Risk),各自有其對應的義務及限制。不可接受的風險,例如在公共場所進行即時遠距生物辨識,或是對人們進行評分,以決定其待遇,或是利用潛意識、人類脆弱性的AI系統;高風險,指需要受到嚴格監管及評估的AI系統,例如應用在電力或交通等基礎建設、執法、邊境管理、僱用及勞動管理的AI系統等等。 有限風險,需要滿足一定程度的公開透明義務,例如AI生成的內容需要標示AI生成,高擬真的AI客服,需要告知人們正與AI互動;至於最低風險,不需要特別的監管措施,例如AI驅動遊戲、垃圾郵件過濾等。 換言之,除了不可接受的風險、最低風險之外,歐盟認為其他程度風險因為帶來的影響性,需要伴隨一定的人為監管措施。 AI應用指引涵蓋AI知識、評估、導入、營運管理 那麼數位部今年底將釋出的AI應用指引,可以為公務機關帶來哪些幫助? 對此,王誠明表示,未來AI應用指引內容並非固定不變,會根據AI發展動態調整指引,鑑於公務人員面臨的問題,例如調查發現公務人員仍有不低的比率對AI的基本知識不足,因此未數位部的AI應用指引將包括AI基本知識,讓團隊成員得以溝通,讓公務人員具備寫AI採購的RFP能力。另外,考慮到缺乏符合機關需求的AI專案說明、實作面說明,未來AI應用指引也會提供AI專案管理所需知道的流程、檢核表,讓公務人員對AI專案管理有一定的認知,檢視專案各個階段是否達到其需求。 數位部正由專家協助研擬AI應用指引,未來AI應用指引的內容將涵蓋AI概念介紹、AI服務評估、AI服務導入、AI營運管理4大章節,共23個子章節。「如同教導學習開車的步驟,拉上安全帶,發動引擎,放掉手煞車」,他說。 AI概念介紹,包括AI的定義、幫助及限制、類別、法規,並且收錄公部門的應用實例,應用指引將AI分為辨別式AI及生成式AI,並介紹兩種類型各自的優缺點,適合的應用。 AI服務評估方面,主要協助機關評估AI是否為適合的解決方案,包含機關面臨的問題如何定義、資料狀態是否準備妥當、政府公開的AI實證;AI服務導入,包含導入模式、AI專案過程、AI專案驗收標準等等;AI營運管理,涵蓋風險管理、倫理議題、資安、AI治理等等。 數位部透露應用指引將AI專案生命周期分為5個階段,涵蓋AI場景評估,確認需求評估合適的解決方法,建置AI專案確認團隊成員,到資料準備及模型開發、測試及迭代、風險控制及專案追蹤,每個階段有其對應的目標及任務,數位部建議機關可以將流程導入整體的規畫,在公務人員在專案流程中得到指引。 王誠明指出,AI專案管理比較困難的是,如何驗收AI專案,AI應用儘管合乎邏輯,但是仍可能因為資料產生偏誤,換言之,正常的訓練可能產生錯誤的結果,專案驗收時需要特別考慮偏誤的問題。未來AI應用指引對於專案驗收提供4個面向的驗收指標,包括模型性能標準、系統穩定性、使用者體驗標準、公平性指標,由於AI仍在發展中,因此指標也隨著變動。 生成式AI帶動新一波AI應用後,王誠明表示,目前公務機關的生成式AI應用場景,以智慧客服、生成摘要,他認為這些僅是目前初步的用法,未來生成式AI將有更大潛力,例如服務流程設計,如何讓服務可以更有效率、更符合民眾的需求,甚至未來可以期待,針對民眾的需求設計服務流程。

數位部

數位部正規畫2026年到2030年政府轉型發展目標,然而在2026年之前,數位部將先祭出配套措施,引導政府機關嚐試導入AI,其中之一是目前正在研擬中,預計今年12月將釋出的政府機關AI應用指引,數位部數位政府司長王誠明將其比喻為電玩攻略,數位部自己則將扮演教練,輔導玩家(機關)依照應用指引以達成轉型目標。

王誠明表示,大型政府機關因擁有的資源較多,很早便投入發展AI應用,例如數據分析型AI或辨識型AI,相較於這些優等生,有的機關可能因為資源有限,或曾經測試AI應用,但發現相關的資料整備不足,服務訓練等配套做法也需調整,最終可能回到既有的做法,數位部希望拉齊各機關的水平,除了規畫中的2026年到2030年大型發展計畫,數位部也提出相關配套措施,如AI人才培訓,以及供機關導入AI之前的試驗環境,評估適合機關自己的LLM模型,還有供政府機關參考的AI應用指引。

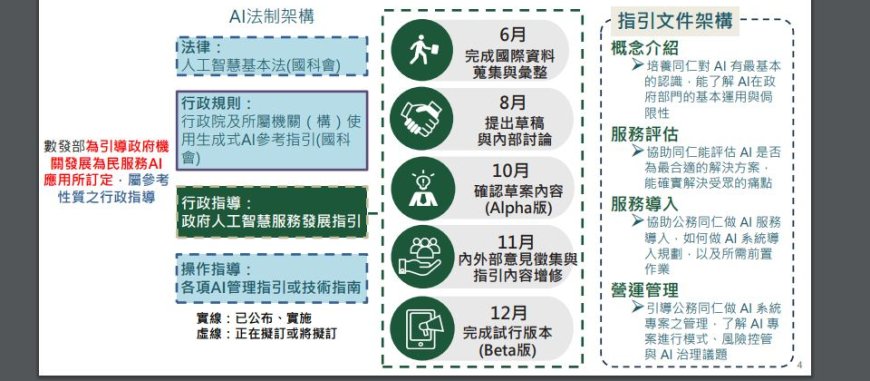

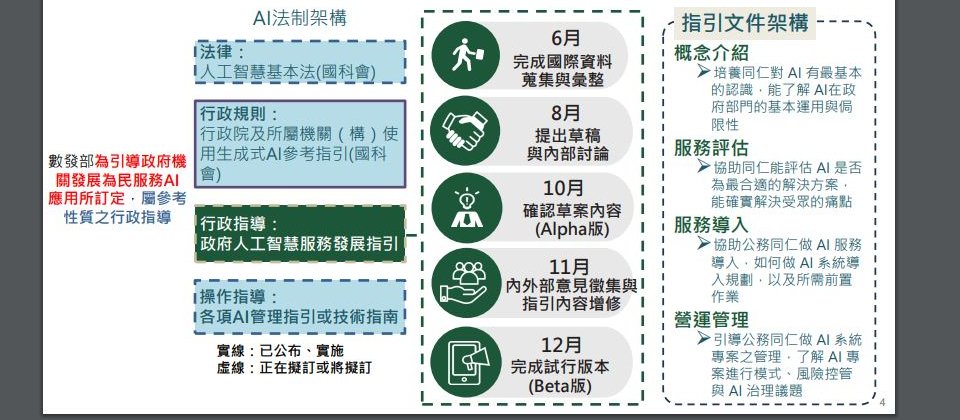

相較於行政院及所屬機關(構)使用生成式AI參考指引,從規範面要求公務人員使用生成式AI不得使用機敏資料,不得以生成式AI產生內容直接取代承辦人員客觀及專業判斷,需經過人工審核等等,透過規範面避免公關機關錯誤運用AI。

王誠明認為這些屬於管制面的規範,缺少教導機關如何發展AI應用,「如同沒有教你怎麼開車,因此透過AI應用指引教導你如何開車」,他說。

歐盟將AI應用風險分為4級

然而在導入AI之前,應該先建立AI風險管理,避免AI帶來負面影響。依照國科會提出我國的人工智慧基本法第十條規定,應由數位部參國際標準或規範,提出與國際介接的人工智慧風險分級框架,王誠明指出,數位部尚未提出我國風險分級框架,數位部未來會參考國際規範,例如歐盟的AI Act法案風險管理框架、美國NIST提出的風險管理框架AI RMF等。

以歐盟為例,AI Act將AI風險畫分為4級,不可接受的風險(Unacceptable Risk)、高風險(High Risk)、有限風險(Limited Risk)、最低風險(Minimal Risk),各自有其對應的義務及限制。不可接受的風險,例如在公共場所進行即時遠距生物辨識,或是對人們進行評分,以決定其待遇,或是利用潛意識、人類脆弱性的AI系統;高風險,指需要受到嚴格監管及評估的AI系統,例如應用在電力或交通等基礎建設、執法、邊境管理、僱用及勞動管理的AI系統等等。

有限風險,需要滿足一定程度的公開透明義務,例如AI生成的內容需要標示AI生成,高擬真的AI客服,需要告知人們正與AI互動;至於最低風險,不需要特別的監管措施,例如AI驅動遊戲、垃圾郵件過濾等。

換言之,除了不可接受的風險、最低風險之外,歐盟認為其他程度風險因為帶來的影響性,需要伴隨一定的人為監管措施。

AI應用指引涵蓋AI知識、評估、導入、營運管理

那麼數位部今年底將釋出的AI應用指引,可以為公務機關帶來哪些幫助?

對此,王誠明表示,未來AI應用指引內容並非固定不變,會根據AI發展動態調整指引,鑑於公務人員面臨的問題,例如調查發現公務人員仍有不低的比率對AI的基本知識不足,因此未數位部的AI應用指引將包括AI基本知識,讓團隊成員得以溝通,讓公務人員具備寫AI採購的RFP能力。另外,考慮到缺乏符合機關需求的AI專案說明、實作面說明,未來AI應用指引也會提供AI專案管理所需知道的流程、檢核表,讓公務人員對AI專案管理有一定的認知,檢視專案各個階段是否達到其需求。

數位部正由專家協助研擬AI應用指引,未來AI應用指引的內容將涵蓋AI概念介紹、AI服務評估、AI服務導入、AI營運管理4大章節,共23個子章節。「如同教導學習開車的步驟,拉上安全帶,發動引擎,放掉手煞車」,他說。

AI概念介紹,包括AI的定義、幫助及限制、類別、法規,並且收錄公部門的應用實例,應用指引將AI分為辨別式AI及生成式AI,並介紹兩種類型各自的優缺點,適合的應用。

AI服務評估方面,主要協助機關評估AI是否為適合的解決方案,包含機關面臨的問題如何定義、資料狀態是否準備妥當、政府公開的AI實證;AI服務導入,包含導入模式、AI專案過程、AI專案驗收標準等等;AI營運管理,涵蓋風險管理、倫理議題、資安、AI治理等等。

數位部透露應用指引將AI專案生命周期分為5個階段,涵蓋AI場景評估,確認需求評估合適的解決方法,建置AI專案確認團隊成員,到資料準備及模型開發、測試及迭代、風險控制及專案追蹤,每個階段有其對應的目標及任務,數位部建議機關可以將流程導入整體的規畫,在公務人員在專案流程中得到指引。

王誠明指出,AI專案管理比較困難的是,如何驗收AI專案,AI應用儘管合乎邏輯,但是仍可能因為資料產生偏誤,換言之,正常的訓練可能產生錯誤的結果,專案驗收時需要特別考慮偏誤的問題。未來AI應用指引對於專案驗收提供4個面向的驗收指標,包括模型性能標準、系統穩定性、使用者體驗標準、公平性指標,由於AI仍在發展中,因此指標也隨著變動。

生成式AI帶動新一波AI應用後,王誠明表示,目前公務機關的生成式AI應用場景,以智慧客服、生成摘要,他認為這些僅是目前初步的用法,未來生成式AI將有更大潛力,例如服務流程設計,如何讓服務可以更有效率、更符合民眾的需求,甚至未來可以期待,針對民眾的需求設計服務流程。

你的反應是什麼?